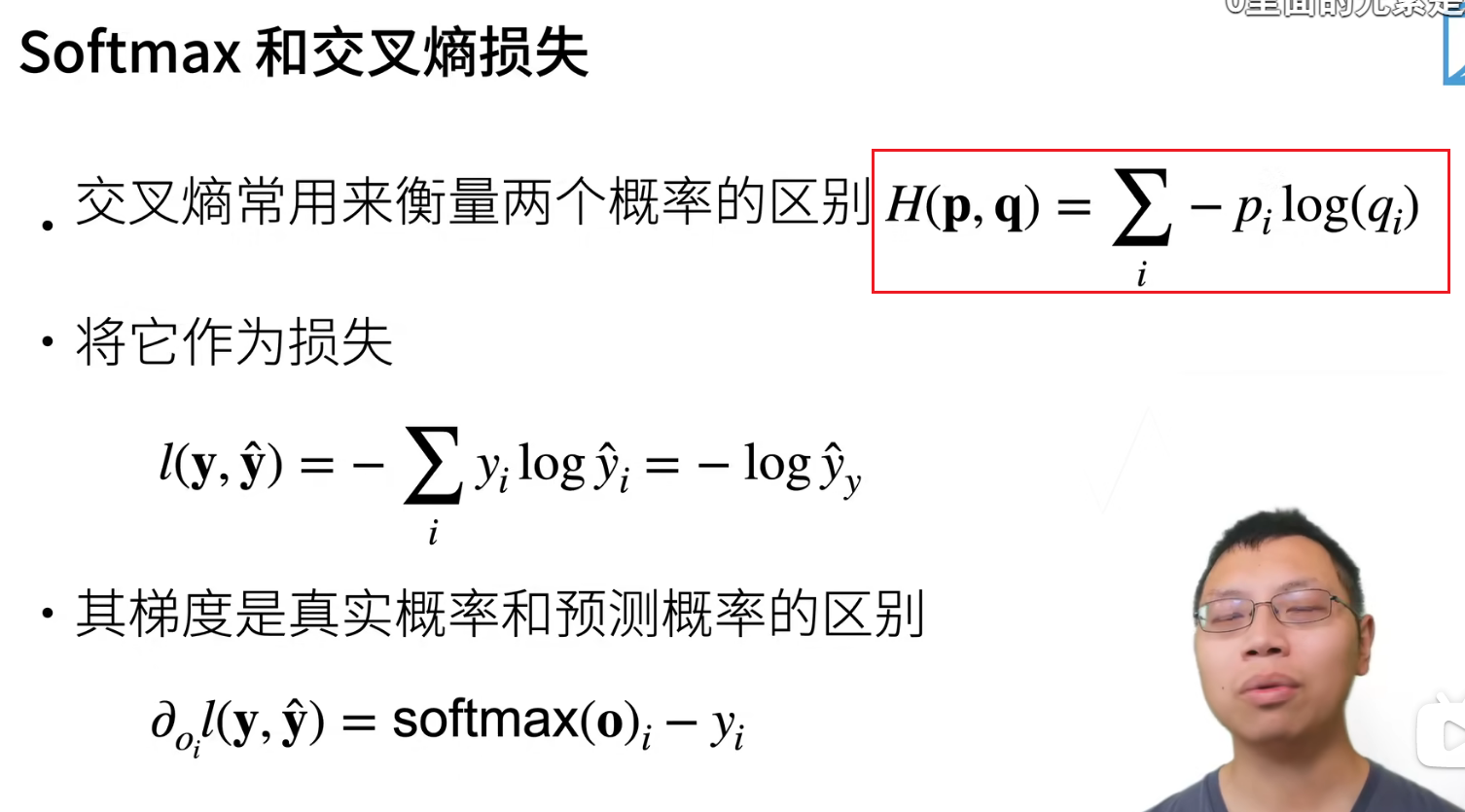

当聚类的方式使用的是某一类预定义好的相似性度量时, 会出现如下情况:

数据聚类方面取得了成功,但它们通常依赖于预定义的相似性度量,而这些度量受原始方法的影响:当输入维数相对较高时,往往是无效的。

1. Deep Multi network Embedded Clustering

2. Deep convolutional self-paced clustering

2.1 存在问题与提出的解决方法

论文的主要贡献:

具体而言,

-

在预训练阶段,我们提出利用卷积自动编码器来提取包含空间相关信息的高质量数据表示。

-

然后,在精调阶段,直接对学习到的特征施加聚类损失,共同进行特征细化和聚类分配。我们保留解码器,以避免特征空间因聚类损失而被扭曲。

-

为了稳定整个网络的训练过程,我们进一步引入了自步长学习机制,并在每次迭代中选择最自信的样本。通过对7个流行图像数据集的综合实验,我们证明了所提出的算法可以持续地超过最先进的竞争对手。

前两个表明, 将特征学习与聚类过程 作为互相辅助的过程,

第三点使用自步 学习的方式,优化过程中样本由易到难,边际样本的不利影响可以得到有效的缓解。 是为了降低不可靠的样本会混淆甚至误导DNN的训练过程,从而严重降低聚类性能。

简单说来, 使用卷积提取特征; 然后对特征进行聚类; 3. 并且在训练过程中,引入自步学习步长机制, 每次迭代过程中选择,最自信的样本;

2.2 实现方法

具体来说,我们的方法包含两个阶段:预训练和微调。

-

在预训练阶段,我们通过最小化重构损失来训练卷积自动编码器 (convolutional autoencoder, CAE) [26]通过使用 CAE,我们的方法可以将数据从一个相对高维和稀疏的空间转换为一个低维和紧凑的空间。

-

,在微调阶段,不同于以往的一些作品[31,32,37]只保留编码器,我们通过使用聚类损失和重构损失对整个自动编码器(即CAE)进行调优,这样可以保留数据属性,避免特征空间的破坏。

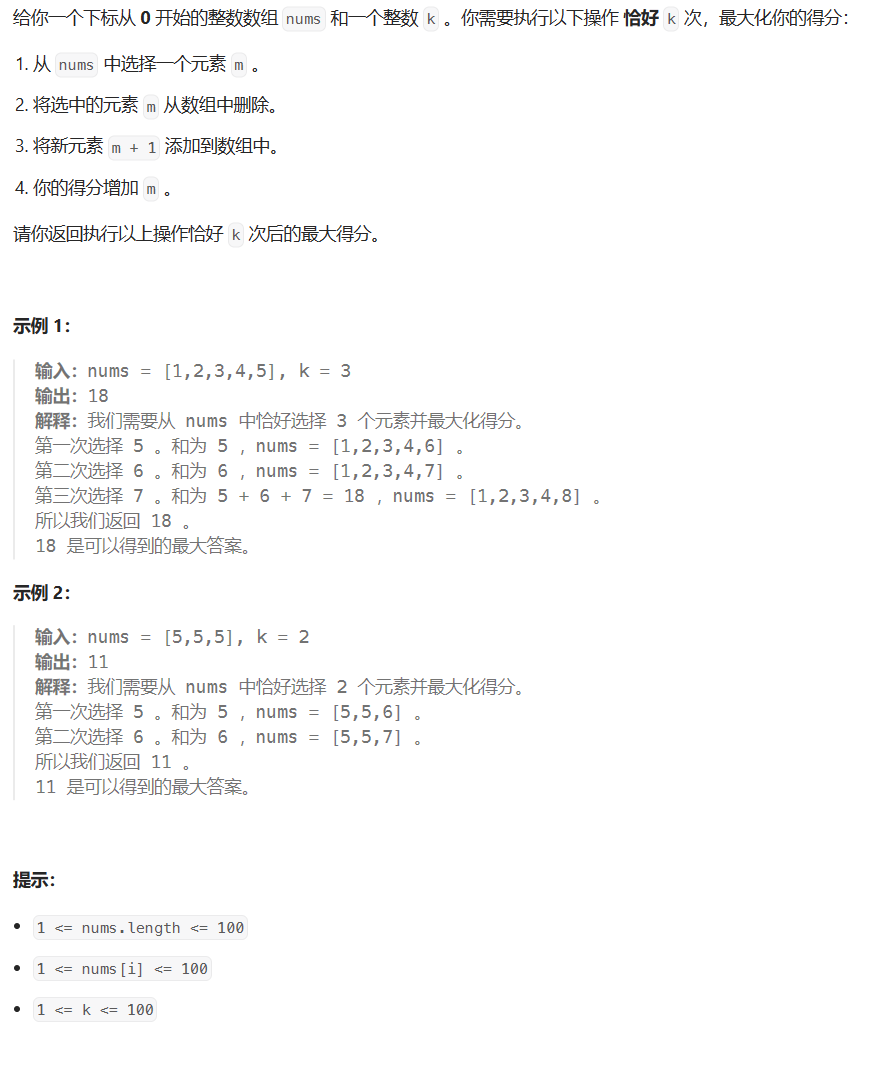

- 问题: 代过程中选择,最自信的样本, 那么如何知道哪些样本的可信度高;